Seit November 2019 ist der Nachfolger (genau genommen: die dritte Iteration) der Mixed-Reality-Brille HoloLens auf dem Markt und setzt nun noch ausgefeiltere Akzente in Sachen 3D-Holographie.

Die Neu-Version wendet sich diesmal ausschließlich an Unternehmen. Anders als beim Vorgänger gibt es keine Konsumenten-Version. HoloLens 2 wurde von Anfang an als Cloud- und Edge-Gerät konzipiert.

Mit vergrößertem Sichtfeld, optimierter Laufzeit und grundlegenden Verbesserungen im Gesamtpaket schürt die neue HoloLens große Hoffnungen.

Sichtbarkeit der Dinge

Bildquelle: blog.ecosystm360.com

Im Unterschied zu Virtual-Reality bleibt die reale Welt unter Mixed-Reality-Anwendungen weiterhin sichtbar, während virtuelle Objekte & Daten die physische Umgebung erweitern und zusätzliche Informationen liefern. Die Technologie der HoloLens 2 soll, dies die Intention der Entwickler, Arbeitsprozesse unterschiedlichster Produktionsstätten optimieren und revolutionieren.

Um z.B. in Laboratorien nützliche Datensätze samt molekularer Strukturen ins Visier zaubern zu können, nutzt Microsoft ein neues Wellenleiter-System. Wellenleiter dienen der spezifischen Umleitung von Lichtstrahlen bzw. deren Auskopplung und Reflexion ins Display. Durch diesen Vorgang wird das virtuelle Bild direkt auf die Netzhaut des Nutzers projiziert.

Mit dem in HoloLens 1 genutzten LCOS-Bildschirm ergab sich hier ein durch den Austrittswinkel der Lichtstrahlen stark reduzierter Sichtbereich von 34 Grad.

Um unter Beibehaltung von Format und Leistung ein größeres FOV erzeugen zu können, setzen die Entwickler, neben einem reduzierten Satz Wellenleiterplättchen in der neuen Iteration, auf ein MEMS-Display: hier projizieren oszillierende Laser das künstliche Bild mit einer Genauigkeit von einem milliardstel Zentimeter anhand von beweglichen Spiegeln in das Auge der Anwender. Bei weiterhin 47 Pixeln pro Grad bietet sich jetzt ein FOV von 52 Grad. Dieser Umstand ist für die Praxis nicht unwesentlich, da sich zuvor bei nur leichten Kopfbewegungen schnell abgeschnittene 3D-Bilder ergaben.

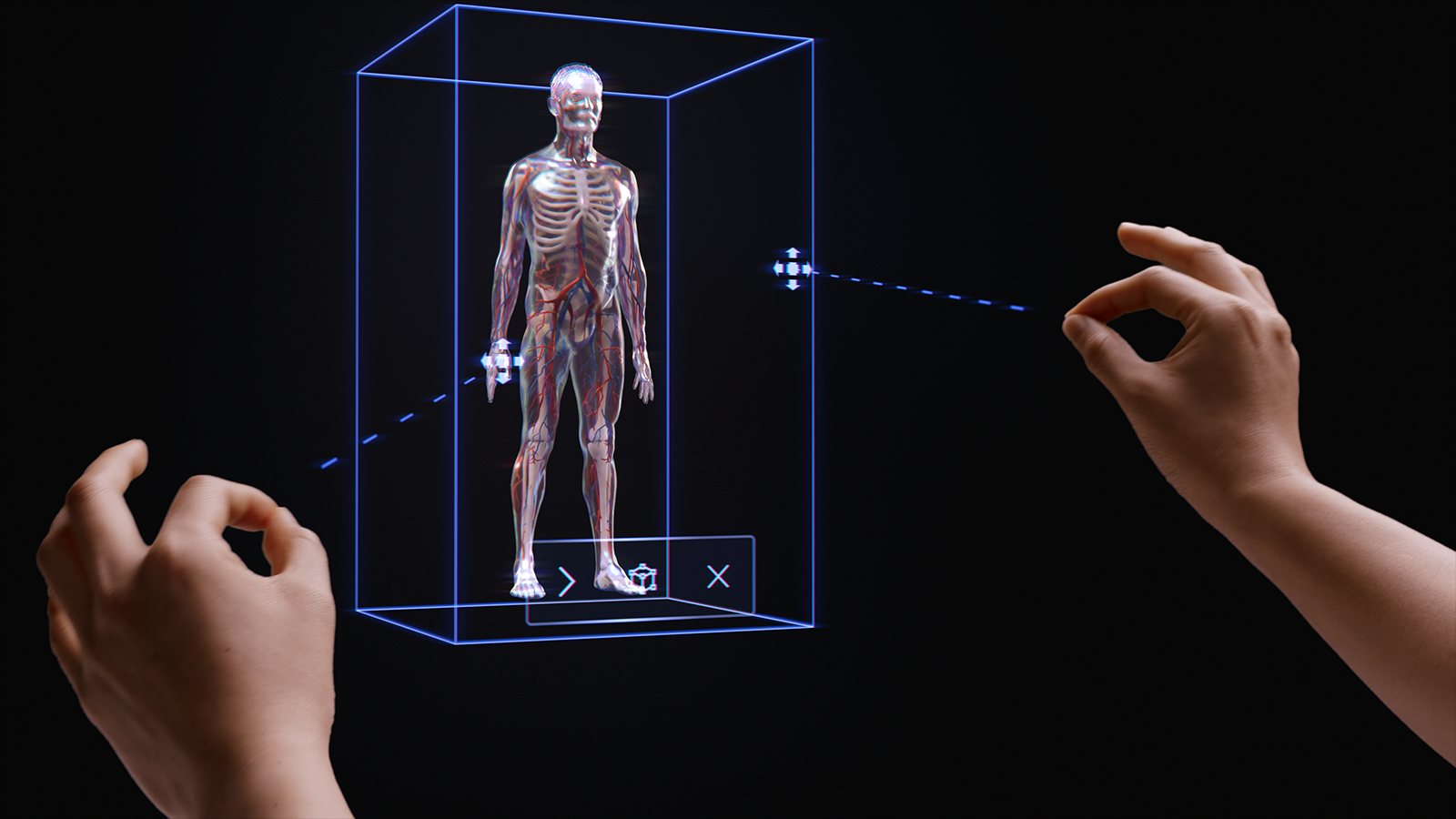

Bildquelle: docs.microsoft.com

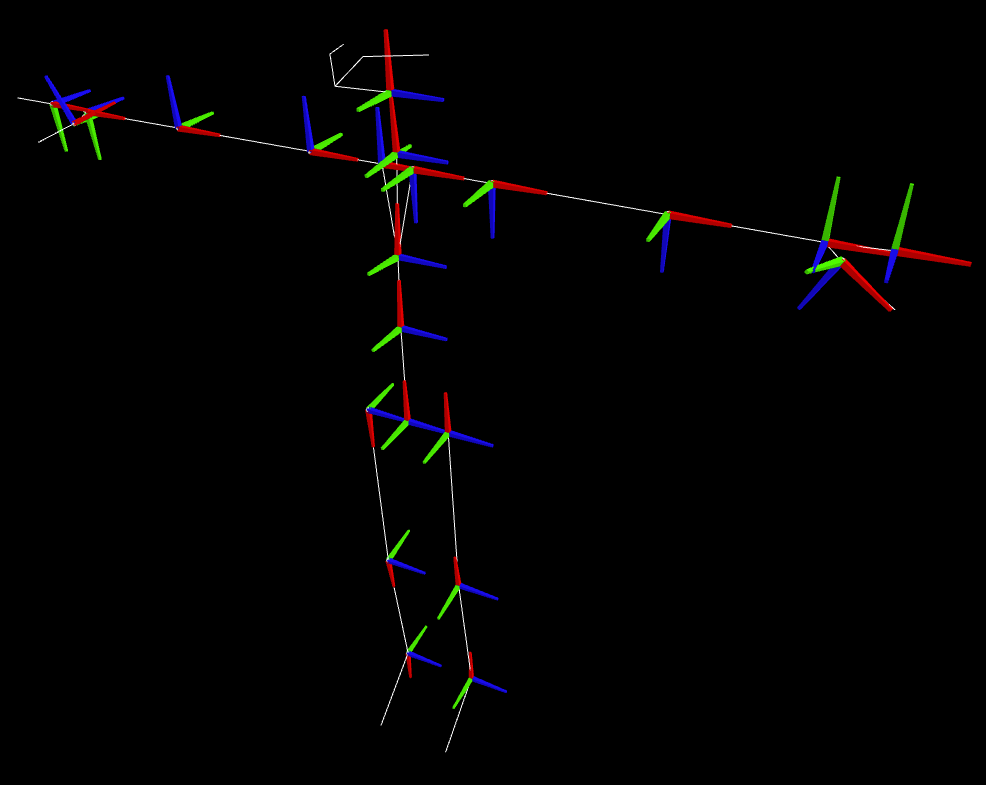

Gelenkkoordinatensystem. Bildquelle: docs.microsoft.com

Koordination im Leichtgewicht

Auch für die Objekt-Interaktion (Azure Kintec Sensorik) ist ein vollständiges virtuelles Bild wichtig. An dieser Stelle hat Microsoft nicht nur mit Eyetracking und Sprachbefehlen nachgerüstet, sondern die Handverfolgung massiv erweitert. Auf Basis eines KI-Algorithmus werden personalisierte 3D-Modelle an Hände und Augen angepasst & eine bessere Handhabung der Hologramme ermöglicht.

Um das Handverfolgungssystem zu optimieren, verwendeten die Entwickler im Vorfeld ein Kamera-Rig zur Aufzeichnung einer Vielzahl von Handbewegungen und deren Ausdrucksformen bei der Interaktion mit Gegenständen, die anschließend in ein 3D-Modell überführt wurden. Gerade in Kombination mit Eyetracking bietet sich dem Anwender so eine sehr genaue und instinktive Interaktionsbasis.

„Without eye tracking, aligning holograms to the real world – especially the person’s physical hand – would just be impossible to the level of precision needed to allow instinctual interaction(…) We want you to know how to use HoloLens without having to be taught how to use it.“

Jamie Shotton, Science Team, HoloLens

Um den Leistungen auch Rechnung tragen zu können, setzt HoloLens 2 im Rahmen der HPU 2.0 auf einen integrierten AI-Co-Prozessor & den Snapdragon 850, der eine hohe Leistungs-Performance bei geringem Energieverbrauch koordiniert.

HoloLens 2 soll eine offenere Plattform bieten: Insofern lässt sich das Gerät spezifisch auf Unternehmen, deren Produktprofile und Anwendungsszenarien anwenden. Dazu gibt es auch bereitgestellte Module für den Einsatz im Gesundheitsbereich, der Bildung oder im Bauwesen.

Neue Verbindungen schaffen

Aus Punktwolken der realen Umgebung werden die späteren 3D-Modelle generiert. Bildquelle: docs.microsoft.com

Über die Azure-Cloud-Plattform bietet Microsoft für die HoloLens 2 „Azure Spatial Anchors“ an.

Mit dieser Technologie können Anwender im Multi-User-Modus anhand eines gemeinsamen Koordinatensystems mit Hologrammen arbeiten und Arbeitsabläufe in Echtzeit durchführen bzw. lokale räumliche Verankerungen speichern und später erneut abrufen. Neben der HoloLens lassen sich geräte-und plattformübergreifend auch Android- und iOS-Geräte (via Google ARCore und Apple ARKit) einbinden & die entsprechenden Anwendungen über die verschiedenen Devices synchronisieren.

Über den Mixed-Reality-Dienst Remote Rendering bietet die Cloud auch die Grundlage zur optimalen Echtzeit-Berechnung hochqualitativer 3D-Assets. Unter Auslagerung der Rechenleistung lassen sich solche 3D-Modelle auf das Gerät übertragen, ohne dass für das Rendering Details dabei eingebüßt werden müssten.

Remote Assist im Einsatz beim Unternehmen MTC, UK. Bildquelle: news.microsoft.com

Eine weitere Anwendung ist Remote Assist aus der „Dynamics 365“-Suite. Mit dieser können sich Außendienstmitarbeiter und Experten verbinden, um sich vor Ort z.B. bei Wartungsarbeiten auszutauschen und visuelle Instruktionen zu erhalten. So lassen sich Rückfragen unter dem Headset auch an geografisch entfernten Orten gemeinsam eruieren und besser veranschaulichen. So können Missverständnisse vermieden werden.

Ausgewählte technische Eigenschaften der HoloLens 2: Transparente holografische Linsen/ Waveguides mit einer Auflösung von 2K 3:2 (Light Engine) & 2.500 Lichtpunkten pro Radiant, Aufnahmen: 8MP Fotos, 1080p/ 30fps Videos 6DoF-Tracking durch 4 verbaute Kameras für sichtbares Licht, Echtzeit-Eyetracking mit Iriserkennung durch zwei verbaute IR-Kameras, 1MP Time-of-Flight-Tiefensensor Qualcomm Snapdragon 850 Compute-Platform, HPU 2.0 und 4-GB-LPDDR4x-System-DRAM Speicherplatz von 64GB UFS 2.1; WiFi- & Bluetooth-5-Unterstützung, USB-C-Anschluss Lithium Batterie, USB-PD-Unterstützung (Schnellladefunktion) 2-3 h Laufzeit |

Wir informieren Sie rund um das Thema „Virtuelle Welten„! Vielleicht haben Sie eine konkrete Projekt-Idee? Unsere Profis der Aspekteins GmbH verfügen über jahrelange Expertise und helfen Ihnen gerne weiter:

HIER KLICKEN FÜR IHRE PROJEKTANFRAGE

Bildrechte Titelbild: © Gorodenkoff – Adobe Stock